10 月 14 日消息,騰訊優圖實驗室今日正式開源 Youtu-Embedding。據介紹,這是一款面向企業級應用的通用文本表示模型,可廣泛應用于企業客服、智能問答、內容推薦、知識管理等場景,尤其適用于構建 RAG 檢索增強生成系統。

附官方介紹如下:

高質量的文本嵌入(Embedding)是驅動智能搜索、檢索增強生成(RAG)以及推薦系統等應用的核心技術。

在傳統的信息檢索系統中,搜索主要依賴倒排索引(Inverted Index)與關鍵詞匹配:系統將文本分解為詞項,通過統計共現頻率或關鍵詞相似度來檢索文檔。這種方法雖然高效,但存在明顯局限 —— 它依賴詞面匹配,無法真正理解語義關系。例如,“汽車保險”和“車輛保障”在語義上接近,卻因為缺少相同詞匯而難以被匹配到。

文本嵌入(Embedding)技術通過深度神經網絡將文本映射到高維向量空間,使語義相似的句子在該空間中距離更近。這一機制讓模型能夠基于語義層面的關聯而非字面重合來完成檢索,從而顯著提升搜索和問答系統的“理解力”。在 RAG(Retrieval-Augmented Generation)場景中,高質量的文本嵌入模型可以為大語言模型(LLM)提供更準確、更上下文相關的外部知識,使生成的答案更加精確、可控與可解釋。

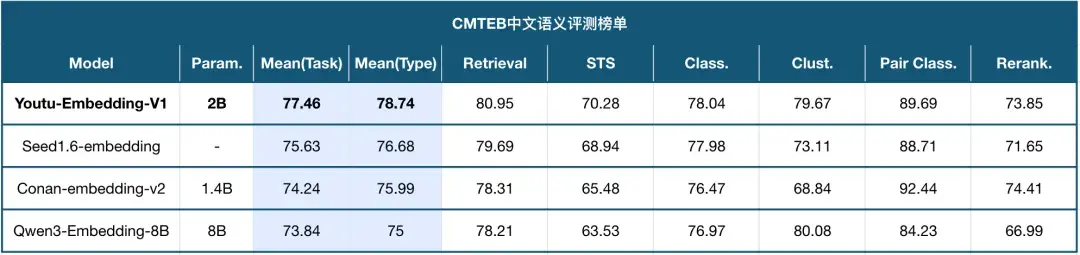

為破解這一難題,騰訊優圖實驗室正式開源 Youtu-Embedding,這是一款面向企業級應用打造的通用文本表示模型,可同時勝任文本檢索、意圖理解、相似度判斷、分類聚類等六大主流任務。它在信息檢索(IR)、語義相似度(STS)、聚類、重排序和分類等一系列廣泛的自然語言處理任務上,均展現出卓越的性能。

Youtu-Embedding 的核心優勢包括:

頂尖性能:在權威的中文文本嵌入評測基準 CMTEB 上,以 77.46 的高分榮登榜首(截至 2025 年 09 月),證明了其強大的表征能力。

精密的三階段訓練:通過“LLM 基礎預訓練 → 弱監督對齊 → 協同-判別式微調”的訓練流程,系統性地將大模型的廣博知識轉化為專用于嵌入任務的判別能力。

創新的微調框架:設計了統一數據格式、任務差異化損失函數和動態單任務采樣機制,解決了多任務學習中的“負遷移”難題,實現了多任務的穩定協同訓練。(該框架在多種基礎編碼器上進行了驗證,保障其通用性和有效性)

精細化的數據工程:結合了基于 LLM 的高質量數據合成技術與高效的難負例挖掘策略,為模型訓練提供了最堅實的數據基礎。

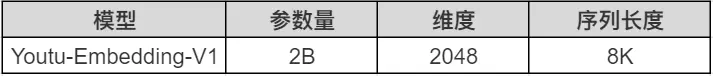

我們在此開源模型權重、推理代碼及完整的訓練框架,首個模型版本已在 HuggingFace 上發布,這是一個擁有 20 億(2B)參數的通用語義表示模型。源代碼已在 GitHub 上開源。