小模型也開始卷起來了!

在麻省理工學院衍生公司Liquid AI發(fā)布了一款小到可以裝在智能手表上的新AI視覺模型,以及谷歌發(fā)布了一款可以在智能手機上運行的小型模型之后,英偉達也加入了這場浪潮,推出了自己的新型小型語言模型(SLM):

Nemotron Nano v2。

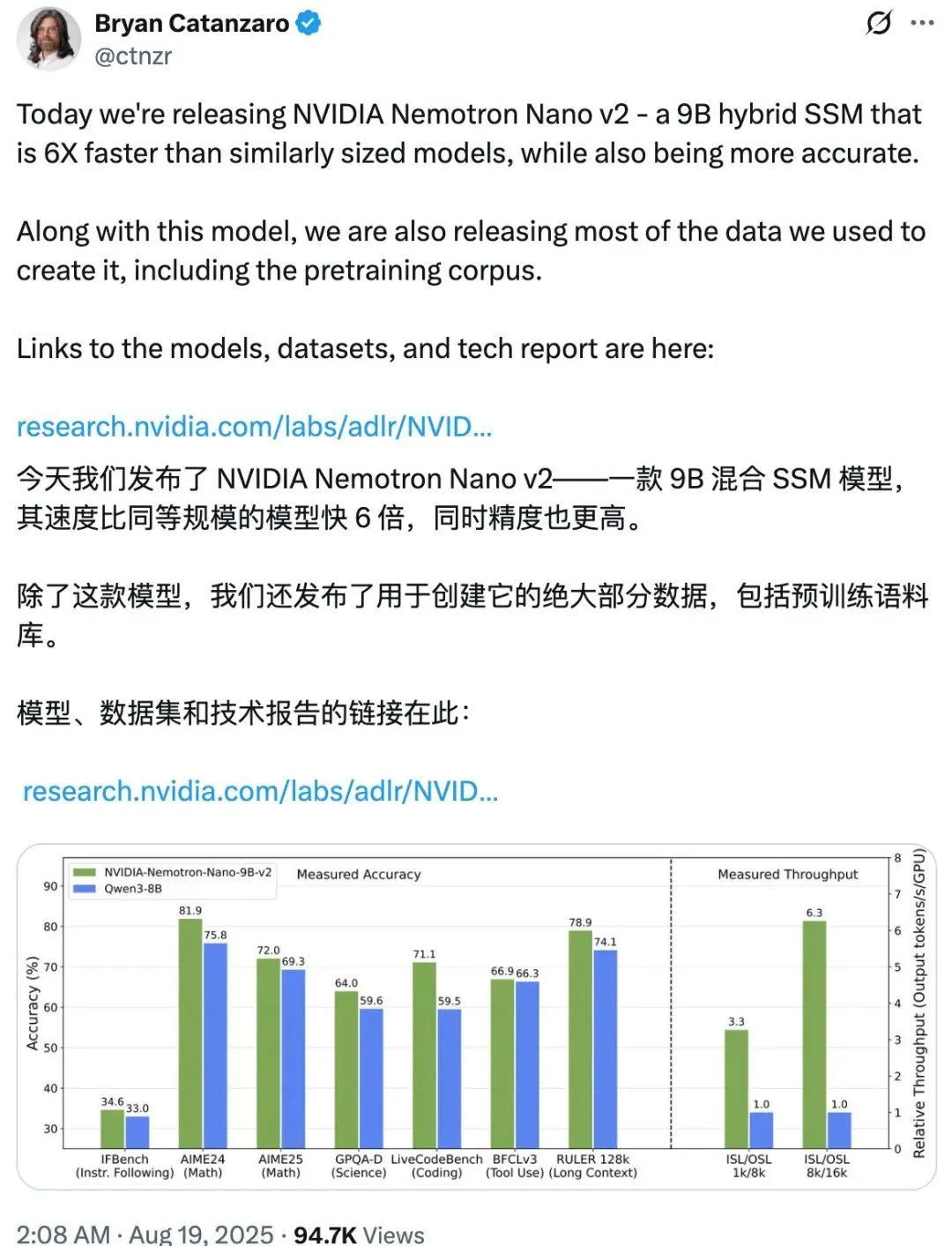

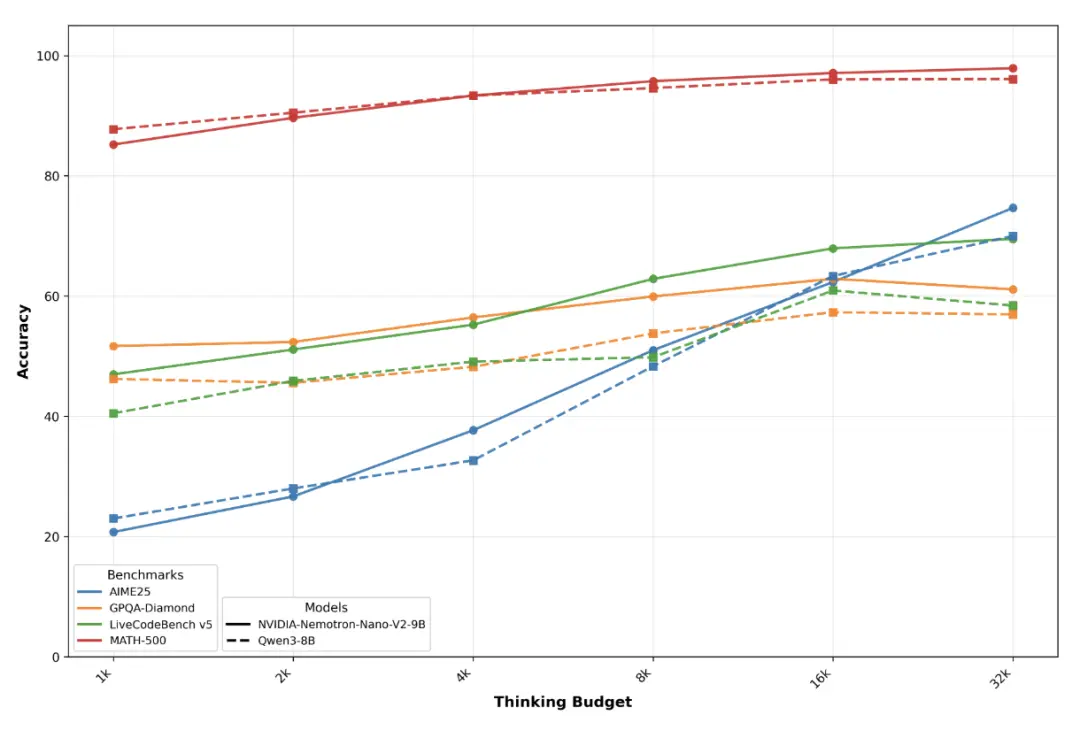

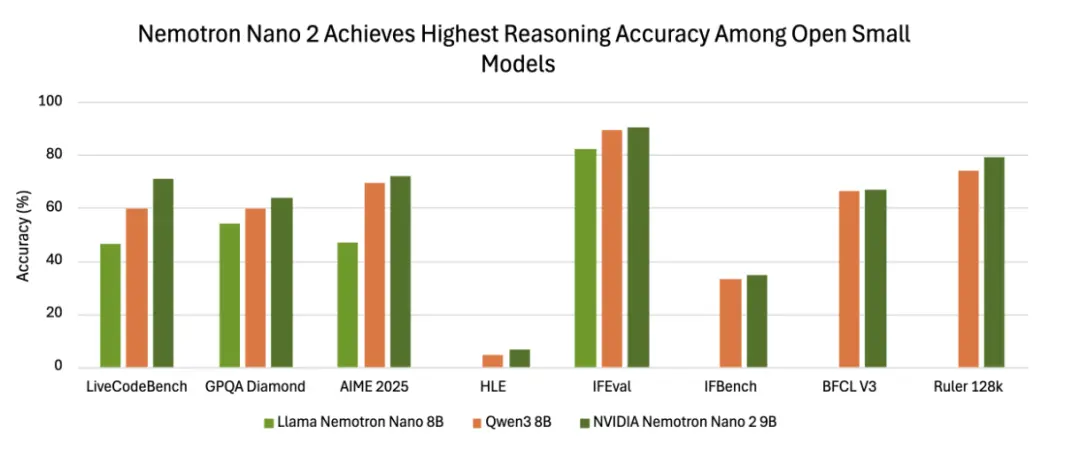

這款9B的“小”模型在復雜推理基準測試上的準確率與Qwen3-8B相當或更高,速度快6倍。

再聯(lián)系到他們前些天發(fā)布的論文觀點:小模型才是智能體的未來,看來真不只是說說而已。

除了這款模型,他們首次“自豪地”開源了用于創(chuàng)建它的絕大部分數(shù)據(jù),包括預訓練語料庫。

讓我們來看一下……20萬億?Nemotron Nano v2在20萬億多個token上進行預訓練?

與Qwen相比速度提升6倍

技術報告顯示,Nemotron Nano v2在復雜推理基準測試上的準確率與同等規(guī)模的領先開源模型Qwen3-8B相當或更高,同時吞吐量——也就是模型速度——最高可提升6倍。

這款模型由英偉達從頭訓練,設計目標是成為兼顧推理與非推理任務的統(tǒng)一模型。

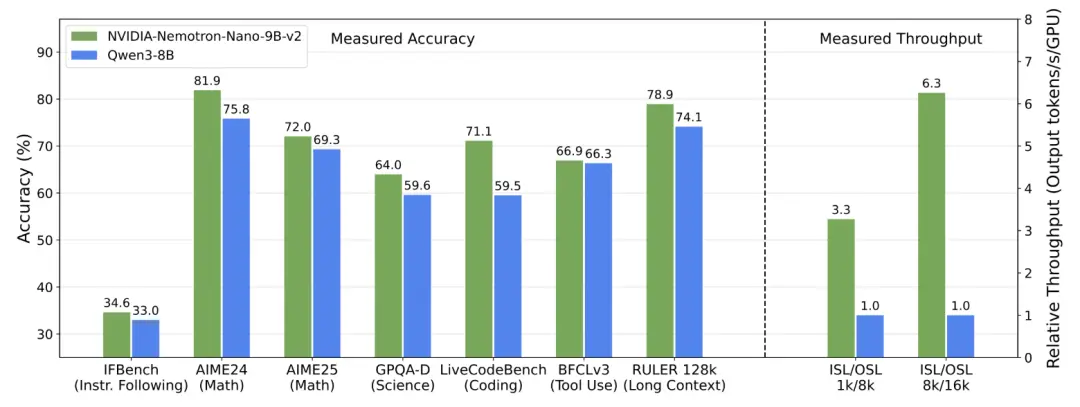

模型在響應用戶查詢或執(zhí)行任務時,會首先生成推理過程(reasoning trace),隨后輸出最終答案。該模型支持“思考”預算控制,在推理過程中,用戶可以指定模型被允許“思考”的token數(shù)量。

如果用戶希望模型直接給出最終答案(跳過中間推理步驟),可通過配置實現(xiàn),但這一做法可能導致對復雜推理類提示的準確率下降。

相反,若允許模型先展示推理過程,通常能顯著提升最終答案的質(zhì)量,尤其針對需邏輯分析的復雜任務。

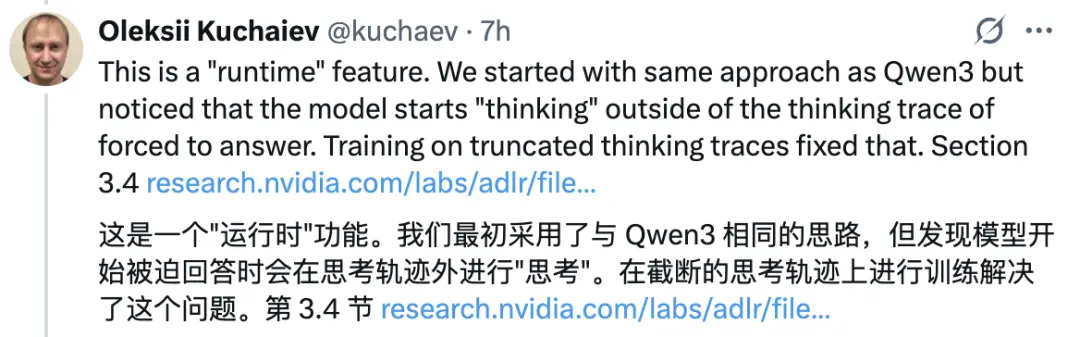

面對網(wǎng)友“思考預算控制是如何實現(xiàn)的”的問題,英偉達的模型訓練師Oleksii Kuchaiev表示:

我們最初采用了與Qwen3相同的實現(xiàn)方法,但發(fā)現(xiàn)當強制要求模型直接輸出答案時,它仍會在預設的思維鏈之外進行“思考”。通過對截斷思維鏈的訓練,我們成功解決了這個問題。

基礎模型同樣開源

評估結果顯示,與其他開源小規(guī)模模型相比,Nemotron Nano v2在準確率上具有優(yōu)勢。在 NeMo-Skills套件的“推理開啟”模式下測試,該模型在AIME25上達到72.1%,在MATH500上達到97.8%,在GPQA上達到64.0%,在LiveCodeBench上達到 71.1%。

在指令遵循和長上下文基準測試中的得分也有報告:在IFEval上達到 90.3%,在RULER 128K測試中達到 78.9%,在BFCL v3和HLE基準測試中也有較小但可測量的提升。

Nemotron Nano v2經(jīng)過了以下訓練過程:

預訓練:模型使用FP8精度在20萬億個token上進行預訓練,采用Warmup-Stable-Decay學習率調(diào)度。隨后進入持續(xù)預訓練長上下文擴展階段,使其在不降低其他基準測試性能的情況下達到128k的能力。

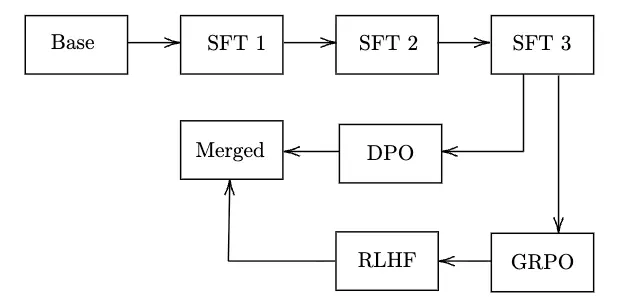

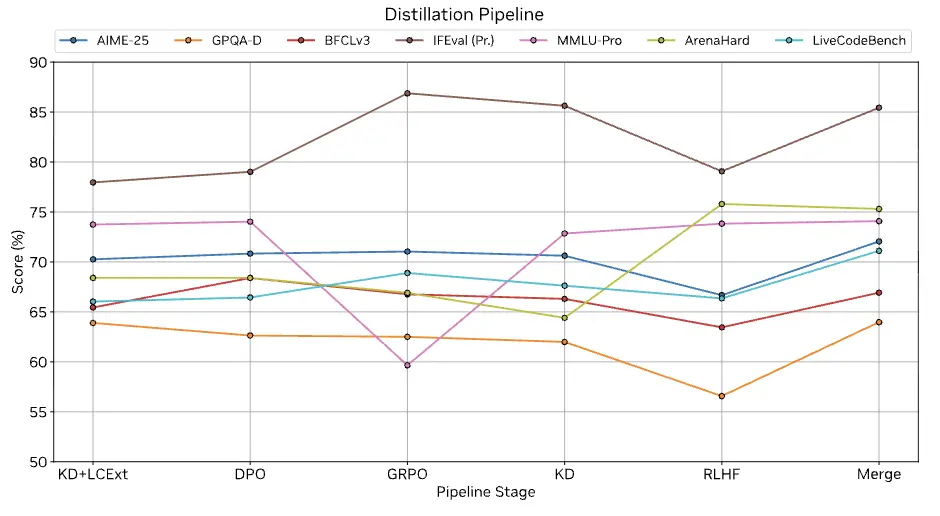

后訓練:Nemotron Nano v2通過監(jiān)督微調(diào)(SFT)、組相對策略優(yōu)化(GRPO)、直接偏好優(yōu)化(DPO)和人類反饋強化學習(RLHF)進行后訓練。約5%的數(shù)據(jù)包含故意截斷的推理軌跡,從而在推理時實現(xiàn)細粒度思考預算控制。

壓縮:最后,基礎模型和對齊模型均經(jīng)過壓縮(剪枝和蒸餾),支持在單個NVIDIA A10G GPU(22 GiB 內(nèi)存,bfloat16 精度)上進行128k token的上下文推理。這一成果是通過擴展基于Minitron的壓縮策略實現(xiàn)的,該策略專門針對受限條件下的推理模型壓縮需求而設計。

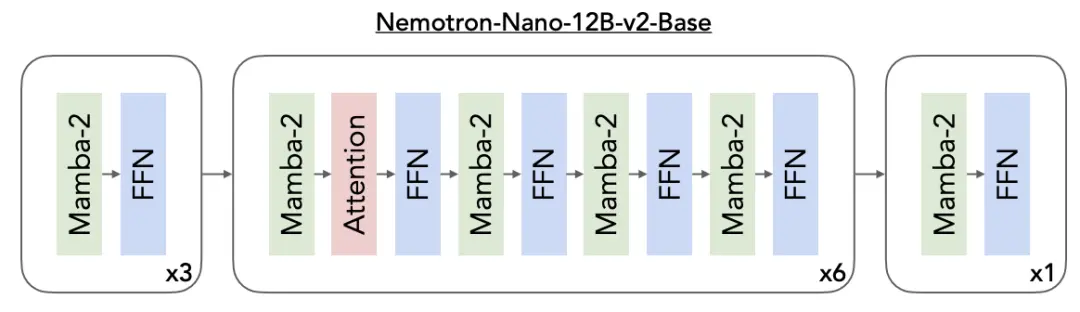

除了Nemotron Nano v2模型本身,英偉達還發(fā)布了兩個基礎模型NVIDIA-Nemotron-Nano-12B-v2-Base(對齊或剪枝前的基礎模型)和NVIDIA-Nemotron-Nano-9B-v2-Base(剪枝的基礎模型),對應模型訓練的不同階段,均支持128k上下文長度。

最后,Nemotron Nano v2當前支持在線試用,鏈接可見文末。

超大預訓練數(shù)據(jù)庫

除了Nemotron Nano v2,英偉達首次發(fā)布了他們用于創(chuàng)建模型的絕大部分數(shù)據(jù),包括預訓練語料庫。

至于為什么是“絕大部分”,有網(wǎng)友問了這個問題,官方回復簡直不要太有道理(笑)。

預訓練數(shù)據(jù)集Nemotron-Pre-Training-Dataset-v1包含66萬億個優(yōu)質(zhì)網(wǎng)絡爬取、數(shù)學、代碼、SFT 和多語言問答數(shù)據(jù),并分為四個類別:

Nemotron-CC-v2:作為Nemotron-CC的升級版本,新增收錄了2024至2025年間八個批次的Common Crawl網(wǎng)絡快照數(shù)據(jù)。數(shù)據(jù)已進行全球去重,并使用Qwen3-30B-A3B進行合成改寫。它還包含翻譯成15種語言的合成多樣化問答對,支持強大的多語言推理和通用知識預訓練。

Nemotron-CC-Math-v1: 一個基于Common Crawl、使用英偉達的Lynx + LLM流程生成的1330億token的數(shù)學專注數(shù)據(jù)集,在保留方程和代碼格式的同時,將數(shù)學內(nèi)容標準化為LaTeX格式。這確保了關鍵的數(shù)學和代碼片段保持完整,從而生成高質(zhì)量的預訓練數(shù)據(jù),在基準測試中優(yōu)于先前的數(shù)學數(shù)據(jù)集。

Nemotron-Pretraining-Code-v1: 一個大規(guī)模的精選代碼數(shù)據(jù)集,源自GitHub,并通過多階段去重、許可證執(zhí)行和啟發(fā)式質(zhì)量檢查進行過濾。它還包括11種編程語言的LLM生成的代碼問答對。

Nemotron-Pretraining-SFT-v1:一個綜合生成的數(shù)據(jù)集,涵蓋STEM、學術、推理和多語言領域。該數(shù)據(jù)集整合了多元化的高質(zhì)量內(nèi)容,包括從數(shù)學與科學核心題庫提取的復雜多選題和分析題、研究生階段的專業(yè)學術文獻,以及經(jīng)過指令微調(diào)的SFT數(shù)據(jù)。

Nemotron-Pretraining-Dataset-sample:該數(shù)據(jù)集的一個小型抽樣版本提供了10個具有代表性的數(shù)據(jù)子集,涵蓋了高質(zhì)量問答數(shù)據(jù)、數(shù)學專項內(nèi)容、代碼元數(shù)據(jù)以及SFT指令數(shù)據(jù)。

那些數(shù)字看起來都嚇人,數(shù)零都得數(shù)半天(目移)。

One More Thing

順帶一提,最近英偉達的開源勢頭可以說是很猛了。

相比于其他國外科技巨頭陸續(xù)走向的閉源道路,英偉達構建的Nemotron生態(tài)直接把開源二字寫在了門面上。

無論是前段時間發(fā)布的Llama Nemotron Super v1.5,還是這次的Nemotron Nano v2,對標的也是國內(nèi)開源模型Qwen3。

這樣的策略會給他們帶來什么?又會改變些什么?我們拭目以待。